「モデルを訓練しない」AI強化の新手法 — Training-Free GRPOが示すLLM活用の転換点

AIを自社の業務に特化させるには、膨大なコストをかけてモデルを「訓練」するしかない——。AI活用を検討する経営者の多くが、そう認識しているのではないでしょうか。2025年10月、Tencent傘下のYoutu Lab(復旦大学・厦門大学との共同研究)が発表した論文「Training-Free GRPO」は、その常識を根底から覆す手法を提案しました。モデルのパラメータを一切書き換えず、わずか約2,700円のコストで、100万円以上かけたファインチューニングを上回る性能を実現したのです。

LLMを特化させる「ファインチューニング」の壁

ChatGPTやClaude、Geminiといった大規模言語モデル(LLM)は汎用的に賢いですが、特定の業務——たとえば数学の証明や、Webからの情報検索——に特化させるには、追加の「訓練」が必要です。その代表的な手法がGRPO(Group Relative Policy Optimization)と呼ばれる強化学習です。

GRPOの仕組みはこうです。ある問題に対してLLMに複数の回答を生成させ、正解・不正解を比較し、「正解を出しやすくなるように」モデルの内部パラメータ(数百億個の数値)を書き換えます。これを繰り返すことで、特定タスクに強いモデルが出来上がります。

しかし、この方法には深刻な課題がありました。

- 巨額のコスト — GPU時間で約150万円($10,000)。中小企業はもちろん、大企業でも気軽に試せる金額ではありません

- 大量の学習データ — 数千件の高品質な正解付きデータが必要。業務固有のデータを用意するだけでも一苦労です

- 過剰適合 — 数学に特化させると、Web検索など他の能力が大幅に落ちます。たとえばReTool(Qwen2.5-32Bをファインチューニングした手法)は、数学のAIME 2024で67.0%を達成しましたが、Web検索タスクでは18.3%まで急落しました

- 小型モデルしか対象にできない — コストの制約から、320億パラメータ(32B)程度の小さなモデルしか調整できません。最先端の大型モデル(671Bなど)には手が出せないのが実情です

出典: Cai et al. (2025) Training-Free Group Relative Policy Optimization, arXiv:2510.08191 / ReTool: Reinforcement Learning for Strategic Tool Use in LLMs, arXiv:2504.11536

Training-Free GRPOの発想 — 「パラメータ」ではなく「文脈」を最適化する

Tencent Youtu Labの研究チームは、まったく異なるアプローチを取りました。「LLMのパラメータを書き換える代わりに、LLMに与える文脈(プロンプト)の中に"経験から学んだ知識"を埋め込めばいいのではないか」という発想です。

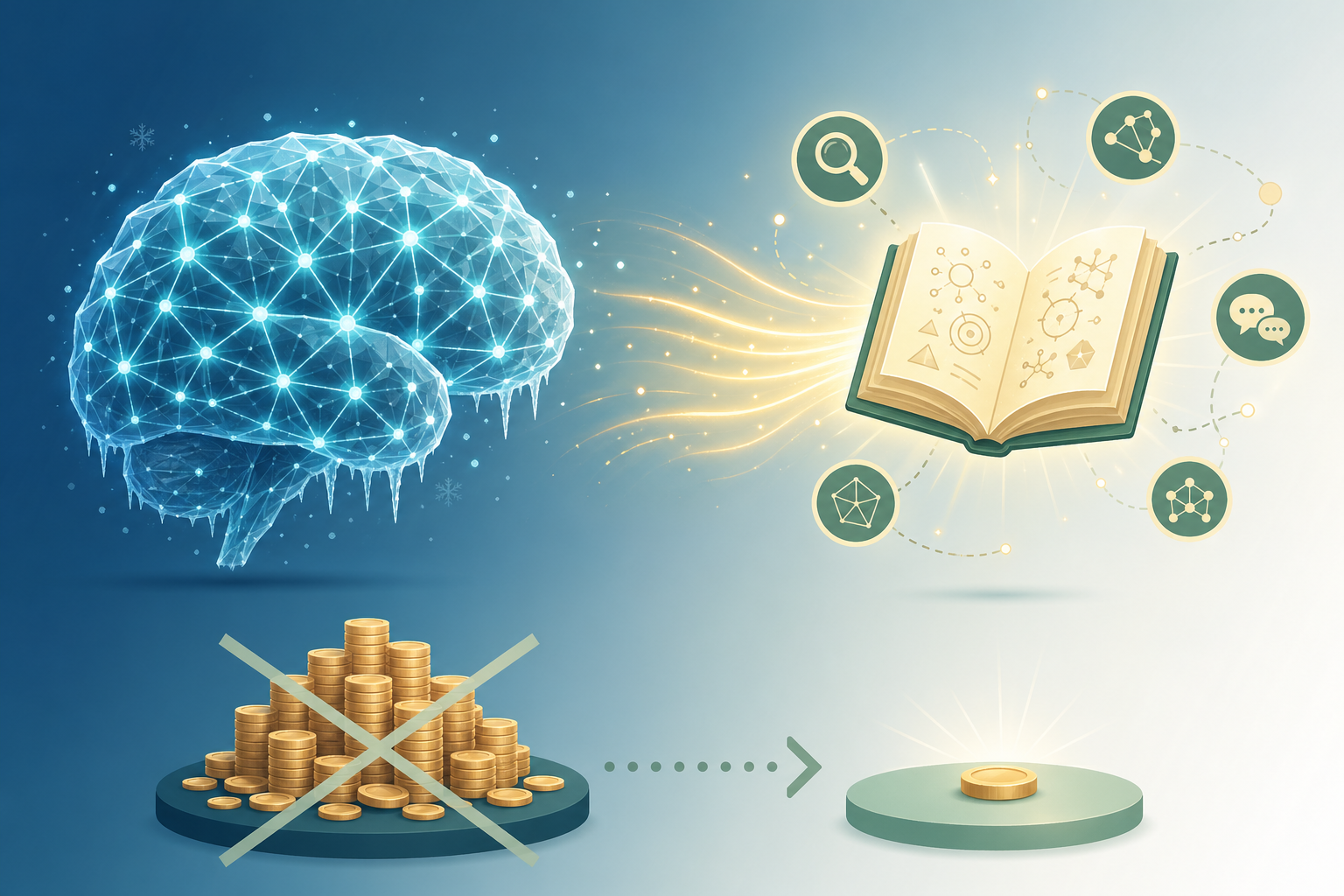

人間に置き換えると分かりやすいでしょう。従来のファインチューニングは「脳の神経回路そのものを書き換える」ようなもの。一方、Training-Free GRPOは「優秀な先輩が書いたノウハウ集を渡して、それを参照しながら仕事してもらう」イメージです。脳(モデル)は変えず、手元の資料(文脈)を充実させることで同じ効果を得ます。

仕組みの全体像

具体的な手順は以下の通りです。

- Step 1 — 複数の回答を生成 — ある問題に対してLLMに5通りの回答を出させます

- Step 2 — 成功と失敗を比較 — 正解と照合し、「成功した回答」と「失敗した回答」を分類します

- Step 3 — 教訓を抽出 — LLM自身に「なぜ成功したのか、なぜ失敗したのか」を自然言語で考察させます

- Step 4 — 経験ライブラリに蓄積 — 得られた教訓を「経験ライブラリ」として保存します

- Step 5 — 次の問題で活用 — 似た問題を解くとき、この経験ライブラリを文脈として注入します

経験ライブラリは固定ではなく、「追加(Add)」「削除(Delete)」「修正(Modify)」「維持(Keep)」の4つの操作で随時更新されます。学習を重ねるごとに、より洗練された知見が蓄積されていく仕組みです。論文ではこの文脈に注入される経験知識を「トークン・プライアー(token prior)」と呼んでいます。

驚異的な結果 — 500分の1のコストで既存手法を超える

この手法をDeepSeek-V3.1-Terminus(6,710億パラメータのフラッグシップモデル)に適用した結果は、研究者たちの予想すら上回るものでした。

| 手法 | モデルサイズ | AIME 2024 | AIME 2025 | 学習コスト |

|---|---|---|---|---|

| ReTool(ファインチューニング) | 32B | 67.0% | 49.3% | 約150万円 |

| ベースライン(調整なし) | 671B | 80.0% | 67.9% | 0円 |

| Training-Free GRPO | 671B(凍結) | 82.7% | 73.3% | 約2,700円 |

AIME(米国数学オリンピック予選)2025で、Training-Free GRPOは73.3%を達成。150万円かけて32BモデルをファインチューニングしたReToolの49.3%を大幅に上回りました。しかも必要な学習データはわずか100問、コストは約2,700円($18)です。

ポイントは、モデル自体は一切変更していないことです。DeepSeek-V3.1-Terminusはそのまま「凍結」した状態で、経験ライブラリという「参考資料」を添えただけ。それだけで、高額なファインチューニングを超える結果が出たのです。

汎用性の維持 — ファインチューニングの致命的弱点を克服

ファインチューニングにはもうひとつ厄介な問題があります。特定のタスクに強くなると、他のタスクの性能が激しく低下する「過剰適合」です。

数学用にファインチューニングされたReToolを、Web検索タスク(WebWalkerQA)で評価したところ、スコアは18.3%まで急落しました。数学に特化させた代償として、Web検索がほぼ使いものにならなくなったのです。

一方、Training-Free GRPOはモデルそのものを変えていないため、この問題が起きません。数学用の経験ライブラリを使えば数学に強くなり、Web検索用の経験ライブラリに差し替えればWeb検索に強くなります。実際、同じ凍結モデルで数学82.7%(AIME 2024)とWeb検索67.8%(WebWalkerQA)を同時に達成しています。

- ファインチューニング型 — モデル自体が変わるため、領域Aに強くすると領域Bが弱くなる。領域ごとに別のモデルが必要

- Training-Free GRPO型 — モデルは1つのまま、経験ライブラリを差し替えるだけ。複数領域に同時対応できる

これは実務上きわめて大きな違いです。企業がAIを導入する際、「経理用」「営業用」「カスタマーサポート用」とモデルを個別に訓練・管理する必要がなくなる可能性を示しています。

企業のAI活用に何をもたらすか

この研究が示す方向性は、企業のAI活用アーキテクチャに根本的な変化をもたらす可能性があります。

「モデルを育てる」から「経験を育てる」へ

これまでの常識は、「AIを自社の業務に合わせるには、モデルそのものを訓練(ファインチューニング)するしかない」というものでした。しかしTraining-Free GRPOは、「巨大な汎用モデルをそのまま使い、文脈に注入する"経験"を育てればいい」という別の道を示しています。

すでに企業のAI活用では、RAG(Retrieval-Augmented Generation:外部の知識ベースを検索して文脈に注入する手法)が主流になりつつあります。RAGの市場規模は2025年に約19.4億ドル、2030年には約98.6億ドルに達するとの予測もあります。RAGが「社内の知識」を文脈で管理するのに対し、Training-Free GRPOは「タスク遂行の経験」までを文脈で管理します。この流れが進めば、企業がAIを業務に組み込む際に「モデルを訓練する」工程はほぼ不要になるかもしれません。

API経由の大型モデルが「特化モデル」を凌駕する構図

API経由で使える大型モデル(DeepSeek、GPT、Claude、Geminiなど)は、提供者側で継続的に性能が向上し、料金もスケールメリットで低下し続けています。一方、自前でファインチューニングした小型モデルは、リリースした瞬間から陳腐化が始まり、保守コストも重くのしかかります。

Training-Free GRPOの結果は、この構造的な力学を数字で裏付けています。671Bの凍結モデル+経験ライブラリの組み合わせが、32Bのファインチューニング済みモデルを性能とコストの両面で圧倒しました。「特化モデルを自前で作る」という戦略が、経済合理性を失いつつあることを示唆するデータです。

中小企業にとっての意味

この研究は直接的には最先端のAI研究の話ですが、経営判断への示唆は明確です。「AIの導入=モデルの訓練」という高コストなアプローチを取る必要はなく、API経由の汎用モデルに自社の業務ノウハウを文脈として与える方が、コスト・性能・保守性のすべてで優れる可能性が高いということです。AI導入のハードルは、技術の進歩とともに確実に下がり続けています。

まとめ

Training-Free GRPOは、LLMの性能向上を「パラメータの書き換え」から「文脈の最適化」へと転換する手法です。

- モデルのパラメータを一切変更せず、「経験ライブラリ」を文脈に注入するだけで性能を向上

- AIME 2025で73.3%を達成——150万円のファインチューニング手法(49.3%)を約2,700円で超えた

- 経験ライブラリを差し替えるだけで、数学でもWeb検索でもトップクラスの性能を発揮

- 企業のAI活用は「モデルを訓練する」から「経験を育てる」時代へ移行する可能性

LLMの性能向上が続く限り、この「巨大な汎用モデルを文脈で動かす」流れは加速するでしょう。

参考資料

- Cai et al. (2025) "Training-Free Group Relative Policy Optimization" — arXiv:2510.08191

- ReTool: Reinforcement Learning for Strategic Tool Use in LLMs — arXiv:2504.11536

- MarketsandMarkets "Retrieval-augmented Generation (RAG) Market worth $9.86 billion by 2030" — marketsandmarkets.com

- GitHub: Training-Free GRPO 実装 — github.com/TencentCloudADP

関連コンテンツ

関連コンテンツ

エネルギー価格が上がるとAIも高くなる?

電気代高騰とAIコストの関係を最新データで解説。AI API価格の急落トレンドや、中小企業が活用できる省エネ・AI導入補助金を紹介します。

詳しく見る →第四次産業革命の次に来るものは、「人間の仕事」かもしれない

AIが広がるほど浮かび上がる「人間にしかできない仕事」。ジャロン・ラニアーの「データ労働」概念から、AIに文脈を渡す仕事の価値、中小企業の強み、活用できる補助金までを解説。

詳しく見る →AIがインフラになる時代、ソフトウェア・ビジネスはどう変わるのか|Microsoft・Cursor・Chamathの事例から読む構造変化

Microsoftの自主退職プログラム、CursorのARR4,000億円でも粗利マイナス、Chamathの「五段階警報」。3つの事例から、AIがインフラ化する時代にソフトウェア・ビジネスがどう変わるかを分析します。

詳しく見る →リスキリング・職業訓練で使える給付金

リスキリング・職業訓練給付金|教育費支援・転職スキルアップの資金調達ガイドについて詳しく解説します。

詳しく見る →この記事を書いた人

X-HACK Inc. 代表取締役 / PARKLoT CTO

Microsoft for Startups Founders Hub 採択

Claude・Cursor・Devin・Runway など 200 種類以上の AI ツールに年間 2,000 万円を投じ、自社の経営・開発・マーケティング全業務で使い倒している「AI ツールの実戦投入実験台」。AI 面接ツールおよび AI 動画編集ツール「GenVox」を開発。「補助金さがすAI」では、自分で試して効果があった AI 活用事例と、それに紐づく補助金制度をセットで解説しています。

AI・DX関連の補助金を活用して、自社のデジタル化を推進しませんか?

補助金を検索する無料会員登録でAI検索が使えます

無料会員登録この記事をシェア